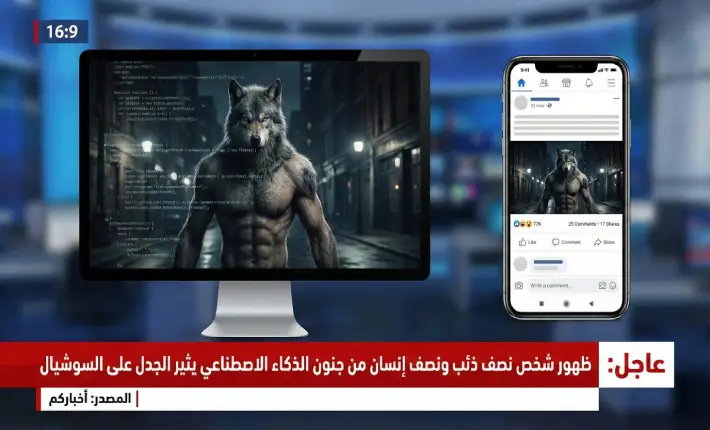

عندما تحلم الآلات بالكوابيس: تحليل شامل لظاهرة “نصف إنسان ونصف ذئب” التي فجرت جدل الذكاء الاصطناعي على السوشيال ميديا

في عصر تتسارع فيه التكنولوجيا بخطى تفوق قدرتنا على الاستيعاب، استيقظ رواد مواقع التواصل الاجتماعي مؤخراً على ما بدا وكأنه مشهد من أعتى أفلام الرعب. صور ومقاطع فيديو انتشرت كالنار في الهشيم، تُظهر كائناً هجيناً، يجمع بين ملامح البشر الشاحبة وشراسة الذئاب، يتجول في بيئات حضرية مألوفة. لم يكن هذا الكائن ممثلاً يرتدي زياً متقناً، ولا خدعة فوتوشوب تقليدية، بل كان نتاجاً مباشراً لما بات يُعرف بـ “جنون الذكاء الاصطناعي” (AI Madness).

هذه الواقعة لم تكن مجرد “تريند” عابر، بل تحولت إلى قضية رأي عام عالمية، مثيرة عاصفة من الجدل والخوف، وطارحة تساؤلات وجودية حول مستقبل الحقيقة في العصر الرقمي. هذا المقال المطول هو محاولة لتفكيك هذه الظاهرة، ليس فقط من زاوية “ماذا حدث؟”، بل الأهم “كيف ولماذا حدث؟”، وكيف يمكن لـ خوارزميات التعلم العميق أن تنتج كوابيس بهذا الإتقان.

تشريح العاصفة.. كيف بدأ “التريند المرعب”؟

بدأت القصة عندما قام أحد المستخدمين المجهولين بتغذية أحد أنظمة الذكاء الاصطناعي التوليدي (Generative AI) المتطورة، مثل Midjourney أو Stable Diffusion، بسلسلة من الأوامر النصية (Prompts) المعقدة والغريبة. كانت الأوامر تطلب دمجاً سريالياً بين التشريح البشري والحيواني في بيئة واقعية مظلمة.

النتيجة كانت سلسلة من الصور فائقة الدقة (Hyper-realistic) التي تظهر كائناً بملامح وجه إنسانية مشوهة، مغطى بالفراء، ويمشي على طرفين في شارع ممطر. ما جعل الصور مرعبة ليس فقط محتواها، بل “الإضاءة الواقعية”، وانعكاسات المياه، وتفاصيل الفراء التي بدت حقيقية لدرجة لا تصدق.

سرعة الانتشار وآلية عمل “الخوف الفيروسي”

بمجرد نشر الصور على منصات مثل “إكس” (تويتر سابقاً) و”تيك توك”، تدخلت خوارزميات السوشيال ميديا التي تفضل المحتوى المثير للجدل. لعبت العوامل التالية دوراً في الانفجار الفيروسي:

- الغموض: تم نشر الصور في البداية دون سياق، مما فتح الباب لنظريات المؤامرة (تجارب جينية سرية، كائنات فضائية).

- الرعب الغريزي: البشر مبرمجون تطورياً للخوف من الكائنات التي تكسر القواعد الطبيعية (نصف إنسان نصف حيوان).

- جودة التزييف: الدقة العالية للصور جعلت حتى المتشككين يتوقفون للحظة للتفكير: “هل يعقل أن يكون هذا حقيقياً؟”.

المحرك الخفي.. كيف يصنع الذكاء الاصطناعي هذه الوحوش؟

لفهم كيف ظهر هذا “المستذئب”، يجب أن نتوقف عن النظر إليه كـ “كائن”، ونبدأ في النظر إليه كـ “بيانات”. هذه الأنظمة لا تفهم البيولوجيا أو الخوف؛ هي تفهم الأنماط الرياضية فقط.

1. نماذج الانتشار (Diffusion Models) وهلوسة البيانات

تعمل معظم مولדות الصور الحديثة بتقنية “نماذج الانتشار”. ببساطة، هي تبدأ بصورة مشوشة تماماً (ضوضاء بيضاء)، ثم تبدأ في “تصفية” هذه الضوضاء تدريجياً بناءً على طلبك، مستعينة بمليارات الصور التي تدربت عليها. عندما تطلب منها “إنساناً وذئباً في جسد واحد”، فإن النموذج يحاول دمج الأنماط البصرية للاثنين.

المشكلة تحدث عندما “يرتبك” النموذج. في محاولته لدمج عين الإنسان مع خطم الذئب، قد ينتج تشوهات بصرية مرعبة. في لغة تعلم الآلة (Machine Learning)، هذا ما نسميه “هلوسة الذكاء الاصطناعي” (AI Hallucination). الآلة لا تتعمد إخافتك، هي فقط فشلت في رسم الواقع بدقة، فانتجت مسخاً.

2. مشكلة “التحيز في البيانات” (Data Bias)

إذا كانت البيانات التي تدرب عليها النموذج تحتوي على الكثير من صور أفلام الرعب أو الفن السريالي المظلم، فسيكون النموذج ميالاً لإنتاج صور ذات طابع كابوسي عند أدنى طلب غامض. “المستذئب” هو انعكاس للمخاوف التي غذيناها نحن البشر للآلة عبر الإنترنت.

سيكولوجية الرعب الرقمي ونظرية “الوادي الموحش”

لماذا شعرنا برعب شديد من هذه الصور تحديداً؟ الإجابة تكمن في نظرية نفسية شهيرة جداً في عالم الروبوتات والرسوم المتحركة تسمى “الوادي الموحش” (Uncanny Valley).

صور “المستذئب” تقع تماماً في قاع هذا الوادي. الجلد البشري واقعي، العيون تشبه عيوننا، لكن النسب مشوهة والشعر ينمو في أماكن خاطئة. هذا التناقض يطلق جرس إنذار في دماغنا القديم يقول: “هذا الشيء يبدو بشرياً لكنه مريض أو خاطئ.. ابتعد عنه!”. الذكاء الاصطناعي، دون قصد، أصبح سيداً في استغلال هذه الثغرة النفسية لدينا.

التداعيات الخطيرة.. ما بعد “تريند” المستذئب

قد نضحك اليوم على صورة المستذئب ونعتبرها مزحة، لكن هذه الواقعة هي جرس إنذار لتحديات أكبر بكثير في مجالات الأمن السيبراني (Cybersecurity) والتضليل الإعلامي.

1. عصر “التزييف العميق” (Deepfakes) وتآكل الحقيقة

إذا كان الذكاء الاصطناعي قادراً على خلق كائن خيالي بهذه الدقة، فما الذي يمنعه من خلق صور وفيديوهات لأشخاص حقيقيين في مواقف ملفقة؟ نحن ندخل عصراً لم تعد فيه “الصورة دليلاً”. هذا يهدد الاستقرار الاجتماعي والسياسي، ويخلق سوقاً ضخمة لخدمات التحقق الرقمي (Digital Forensics).

2. التأثير على الصحة النفسية الرقمية

التعرض المستمر لمثل هذه الصور الصادمة، خاصة للأطفال والمراهقين على منصات مثل تيك توك، قد يؤدي إلى نوع جديد من القلق الرقمي. الخوف من المجهول، وعدم القدرة على التمييز بين الحقيقة والخيال، قد يتطلب تدخلاً من مختصي الصحة النفسية (Mental Health) للتعامل مع “صدمات المحتوى الرقمي”.

3. اقتصاد الانتباه القائم على الصدمة

كشفت الواقعة كيف أن اقتصاد السوشيال ميديا يكافئ المحتوى الصادم. المبدعون الذين استخدموا الـ AI لإنشاء هذه الصور حصلوا على ملايين المشاهدات، وبالتالي عوائد إعلانية ضخمة. هذا يخلق حافزاً لإنتاج المزيد من “الرعب المصطنع” لجذب الانتباه، بغض النظر عن التأثيرات المجتمعية.

كيف تحمي نفسك؟ دليلك لكشف زيف صور الذكاء الاصطناعي

في مواجهة هذا الطوفان من الصور المولدة، يجب أن نطور “محو أمية بصرية” جديدة. إليك أهم العلامات التقنية التي تفضح صور الـ AI حتى الآن:

- مشكلة الأطراف والأصابع: لا يزال الذكاء الاصطناعي يواجه صعوبة بالغة في رسم الأيدي البشرية بشكل صحيح. ابحث عن أصابع زائدة، مفاصل مشوهة، أو أطراف تذوب في بعضها البعض.

- النصوص والخلفيات المشوشة: إذا كانت الصورة تحتوي على لافتات محلات أو كتابة في الخلفية، غالباً ما تكون حروفاً غير مفهومة أو لغة فضائية غريبة.

- التماثل غير المنطقي والإضاءة: ابحث عن أخطاء في الظلال. هل اتجاه الظل يتوافق مع مصدر الضوء؟ الـ AI يخطئ كثيراً في فيزياء الضوء المعقدة.

- “الملمس البلاستيكي” المفرط: أحياناً تبدو البشرة أو الأسطح ناعمة جداً أو لامعة بشكل غير طبيعي، وكأنها مصنوعة من البلاستيك المصقول.

الخاتمة: هل نحن مستعدون للمستقبل؟

واقعة “نصف الإنسان ونصف الذئب” ليست سوى قمة جبل الجليد. إنها تذكير صارخ بأن التكنولوجيا أداة قوية ومحايدة، يمكنها أن تخلق الجمال، ويمكنها أن تجسد كوابيسنا الأكثر ظلمة. التحدي الآن ليس في إيقاف تطور الذكاء الاصطناعي، فهذا مستحيل، بل في تطوير وعينا النقدي، وتشريع قوانين تنظم استخدام هذه التقنيات، والاستثمار في أدوات كشف التزييف (AI Detection Tools).

الفيديو بالأسفل